AI Task平台使用手册

实验流程_平台可视化版本

01-数据工程

02-复制算法

03-模型训练

04-模型推理

05-模型编译

06-模型下载并固化

07-本地推理

08-附:镜像配置与保存

实验流程_NoteBook版本

01-数据工程

02-算法创建

03-模型训练

04-模型推理

05-模型编译

06-模型下载并固化

07-本地推理

08-附:镜像配置与保存

本文档使用 MrDoc 发布

-

+

首页

07-本地推理

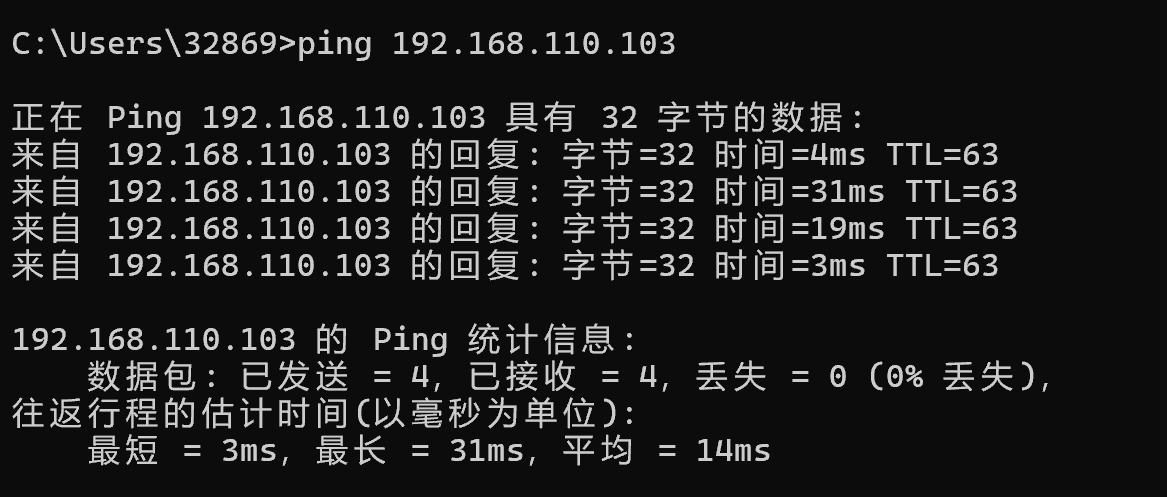

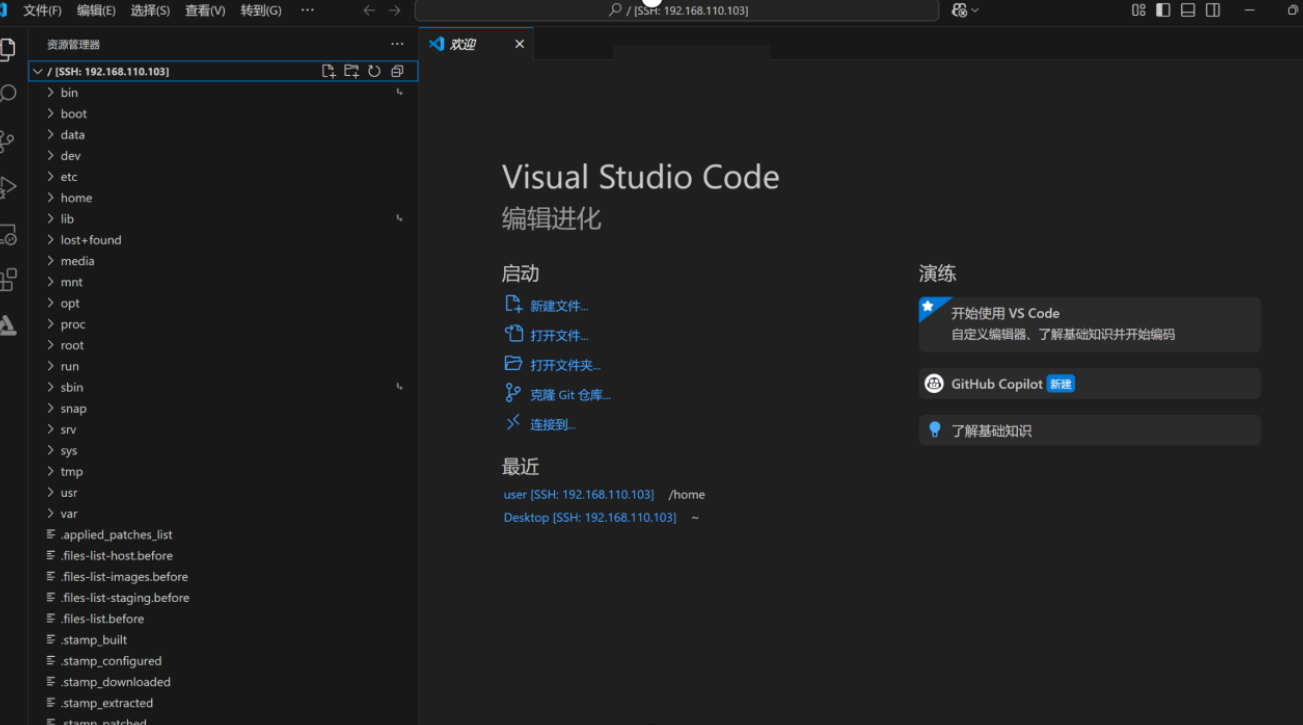

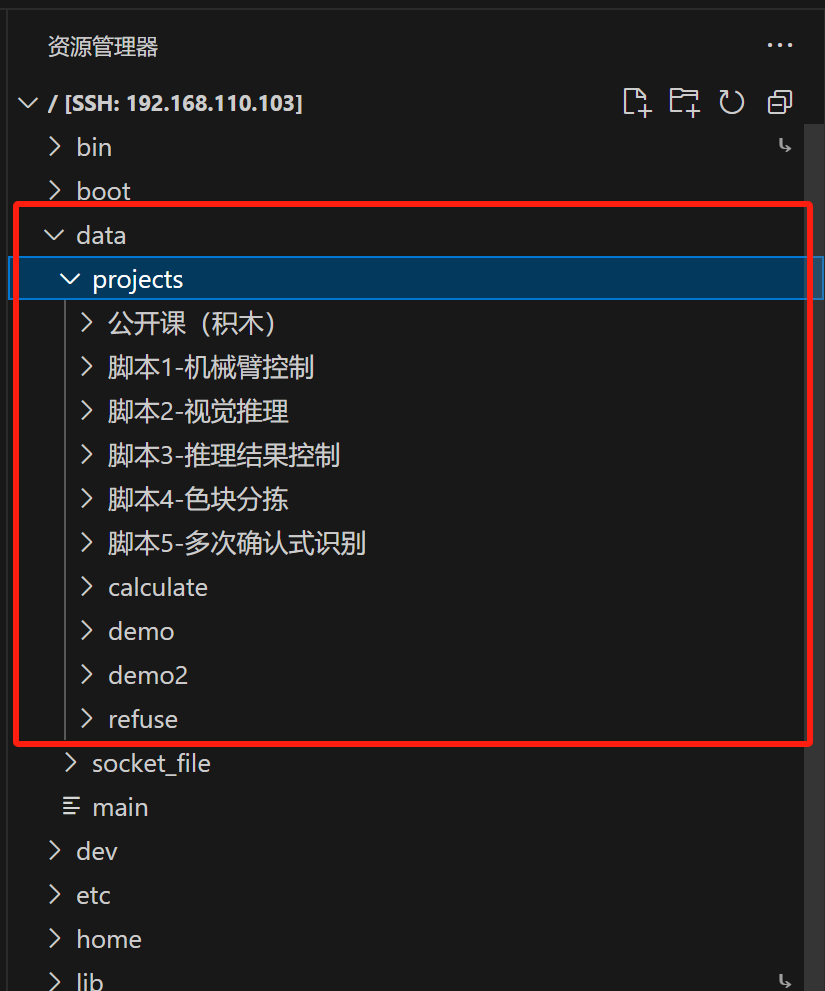

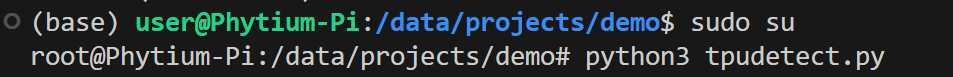

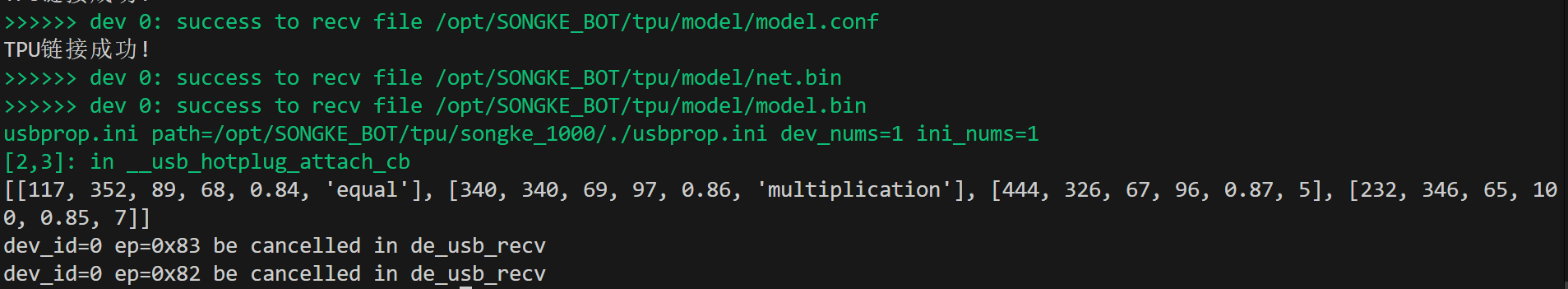

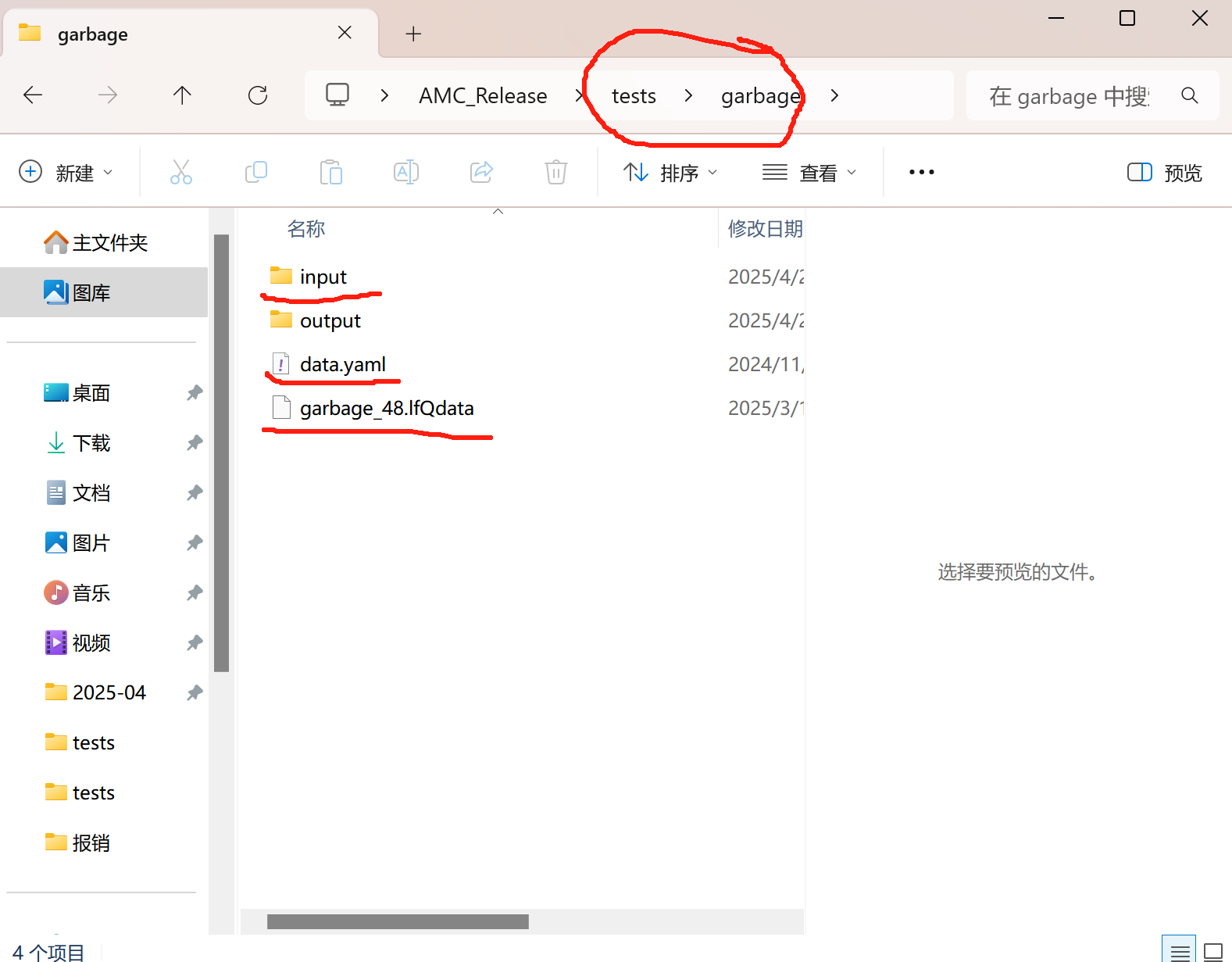

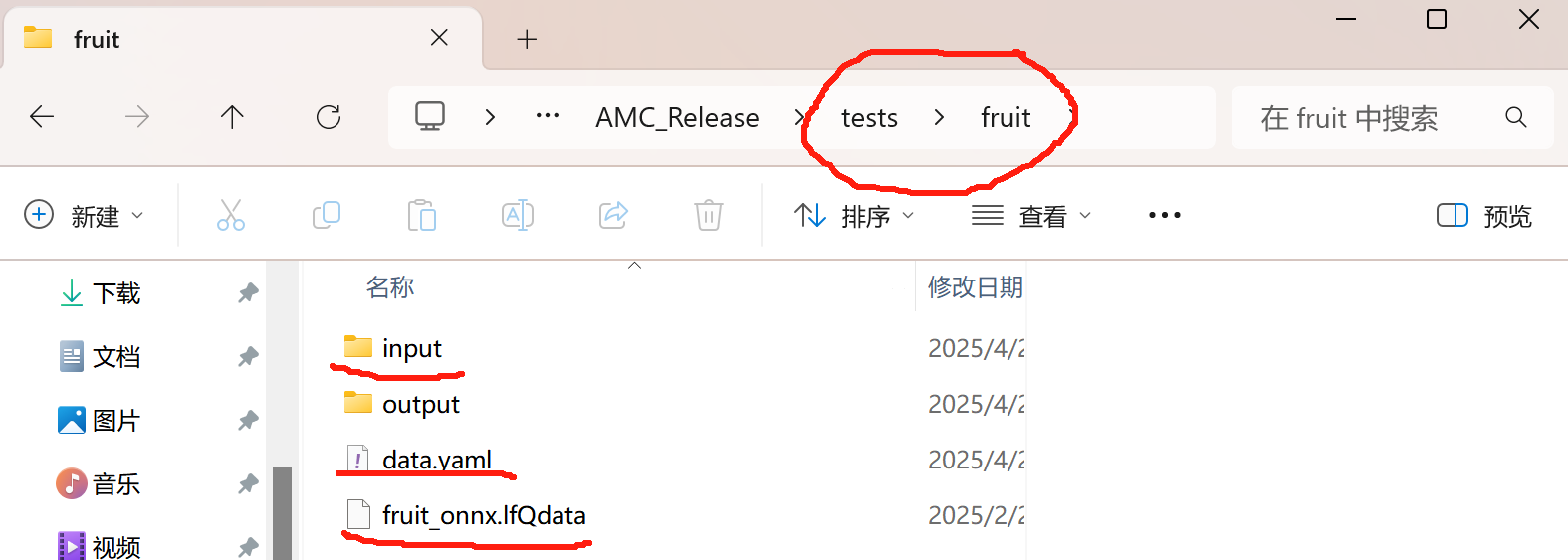

7.1基于机器人:TPU插机械臂上,电脑连接机械臂(无线)。机械臂拍照,在TPU上进行推理,TPU得到推理结果返回给机械臂。电脑全程没有参与,电脑只是与机械臂进行数据传输,从而让电脑可以显示机械臂的信息。 7.1.1将电脑与机械臂置于同一局域网下进行无线连接(详见电脑与机器人连接说明),打开电脑终端查看是否连接成功。 ping 192.168.110.103(此为机械臂无线地址)  7.1.2打开vscode或pycharm,使用ssh远程连接机械臂  7.1.3连接成功后即可进入data/projects目录中查看刚刚固化好的模型,模型名称为固化时的名称,/data/projects为TPU模型的存放目录。  7.1.4进入刚刚固化好的模型目录中,新建tpudetect.py文件进行本地推理,代码如下: ```python from arm_module import Control_Arm as arm #机械臂 from tpu_module import Control_TPU as tpu #TPU from cap import VideoCapture #摄像头 mode = False #无线远程连接 model_name = "demo" #模型名称 conf = 0.5 #精度 iou = 0.45 #IoU阈值 width = 640 #图片宽度 height = 640 #图片高度 arm.reset_position() #机械臂复位 cap = VideoCapture() #调用摄像头拍照 img = cap.read() #读取图片 result = tpu.predict(img, mode=mode, model_name=model_name, conf=conf, iou=iou, w=width, h=height) print(result) cap.release() #释放摄像头资源 ``` 7.1.5在终端运行代码,首先使用 sudo su进入超级root权限 python3 tpudetect.py运行Python文件  出现结果,推理完成。  7.2基于windows系统:TPU插在电脑上,配置本地环境,进行TPU模型推理。 7.2.1安装anaconda进行python环境管理 安装教程可参考:https://www.cnblogs.com/ajianbeyourself/p/17654155.html 7.2.2进入Anaconda Prompt 创建虚拟环境,输入conda create -n amc python=3.9 7.2.3进入创建的环境 conda activate amc 7.2.4下载解压本地推理附件压缩包,从prompt进入目录安装相关依赖 cd /Desktop/AMC_release/tests pip install -r requirements.txt 7.2.5安装ai_stick包,进入host-sdk文件下: cd ../host-sdk pip install ai_stick-1.1.1-py3-none-any.whl 7.2.6模型推理 7.2.6.1检测模型推理(以垃圾检测模型为例) (1)在tests文件下,创建garbage文件 (2)将测试图片、模型和yaml文件放到garbger文件下 (3)进入tests文件下,执行推理 cd tests python yolov5s_det_inference.py -m garbage_48.lfQdata -i garbage -s 3x640x640 -t 0.5 -n 0.45  参数解释: -m, --model_name: 模型名称(必要) -i, --input_file: 包含图片、模型和yaml文件的文件夹名称(必要) -s, --input_size: 模型输入的size,默认3x640x640(可选) -t, --obj_thresh: 目标检测阈值,默认0.5(可选) -n, --nms_thresh: IOU阈值,默认0.45(可选) 7.2.6.2分类模型推理(以水果分类模型为例) (1)在tests文件下,创建fruit文件 (2)将测试图片、模型和yaml文件放到fruit文件下 (3)执行推理 python yolov5s_cls_inference.py -m garbage_48.lfQdata -i garbage -s 3x224x224  参数解释: -m, --model_name: 模型名称(必要) -i, --input_file: 包含图片、模型和yaml文件的文件夹名称(必要) -s, --input_size: 模型输入的size,默认3x224x224(可选) ==注意:若出现libusb文件缺失,则将附件压缩包中的libusb-1.0.dll文件移动到C:\Users\32869\anaconda3\envs\amc\Library\bin目录下(即anaconda下的envs\amc\Library\bin)== 7.3基于linux系统:除了最开始需要进入root用户外,其他操作与windows系统相同。即在进入推理项目目录前先执行: sudo su 然后进入推理目录: cd /Desktop/AMC_release/tests 后续操作同windows

gdsoke

2025年4月23日 18:36

转发文档

收藏文档

上一篇

下一篇

手机扫码

复制链接

手机扫一扫转发分享

复制链接

Markdown文件

分享

链接

类型

密码

更新密码